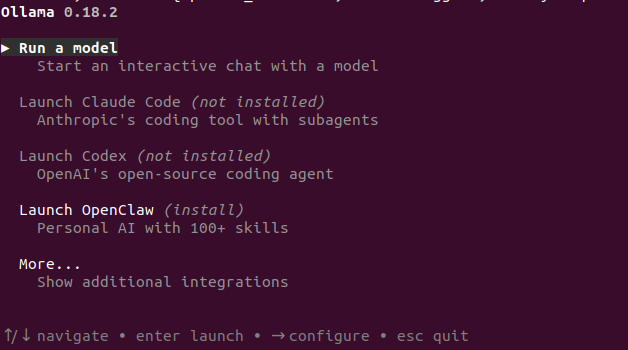

Устанавливаем Ollama

curl -fsSL https://ollama.com/install.sh | sh

Проверяем что запущено

ollama

Устанавливаем простую модель

ollama run qwen2.5:1.5b-instruct

Проверяем что адрес доступен

http://host.docker.internal:11434/api/tags

Результатом должно быть

{

"models": [

{

"name": "qwen2.5:1.5b-instruct",

"model": "qwen2.5:1.5b-instruct",

"modified_at": "2026-03-24T13:09:40.548521416+03:00",

"size": 986061892,

"digest": "65ec06548149b04c096a120e4a6da9d4017ea809c91734ea5631e89f96ddc57b",

"details": {

"parent_model": "",

"format": "gguf",

"family": "qwen2",

"families": [

"qwen2"

],

"parameter_size": "1.5B",

"quantization_level": "Q4_K_M"

}

}

]

}

Далее настраиваем Budibase (далее ИИ)

Настройка собственного AI агента в Budibase для работы с локальной моделью Ollama (например, qwen2.5:1.5b-instruct) выполняется через конфигурацию провайдера с OpenAI-совместимым API. Вот пошаговая инструкция.

Шаг 1: Убедитесь, что Ollama запущена и модель загружена

Перед настройкой Budibase убедитесь, что Ollama работает и модель доступна.

Откройте терминал и выполните:

# Запустите сервер Ollama, если он еще не запущен

ollama serve

В другом окне терминала убедитесь, что модель загружена (или скачайте её):

# Загрузите модель, если она еще не установлена

ollama pull qwen2.5:1.5b-instruct

Ollama по умолчанию запускает API на http://localhost:11434. Убедитесь, что порт доступен.

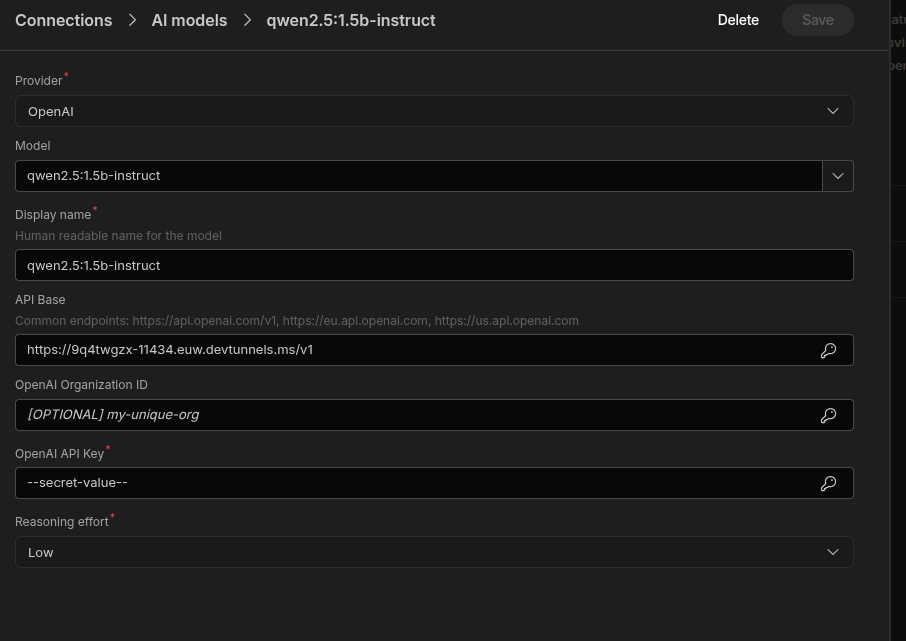

Шаг 2: Настройка AI провайдера в Budibase

Budibase использует единую конфигурацию AI для всего Workspace. Для подключения локальной модели нужно указать её как OpenAI-совместимый эндпоинт.

- Откройте настройки Workspace: Нажмите на иконку шестеренки (Settings) в левом нижнем углу Budibase.

- Перейдите в раздел AI: В меню настроек выберите пункт AI.

- Выберите провайдера: В выпадающем списке «Provider» выберите OpenAI.

- Введите данные подключения:

- API Key: Так как Ollama работает локально и не требует ключа, введите любое значение (например,

ollamaилиdummy). Поле не должно быть пустым. - URL (Endpoint): Введите адрес вашего локального сервера.

- Стандартный URL:

http://localhost:11434/v1 - Важно: Добавьте

/v1в конце пути, чтобы указать на совместимую версию API.

- Стандартный URL:

- Model Name: Укажите точное имя модели, которую вы загрузили. В вашем случае это

qwen2.5:1.5b-instruct.

- API Key: Так как Ollama работает локально и не требует ключа, введите любое значение (например,

- Сохраните настройки: Нажмите кнопку «Save» (или «Enable») внизу. Budibase проверит соединение, и если все настроено верно, вы увидите зеленый индикатор статуса.

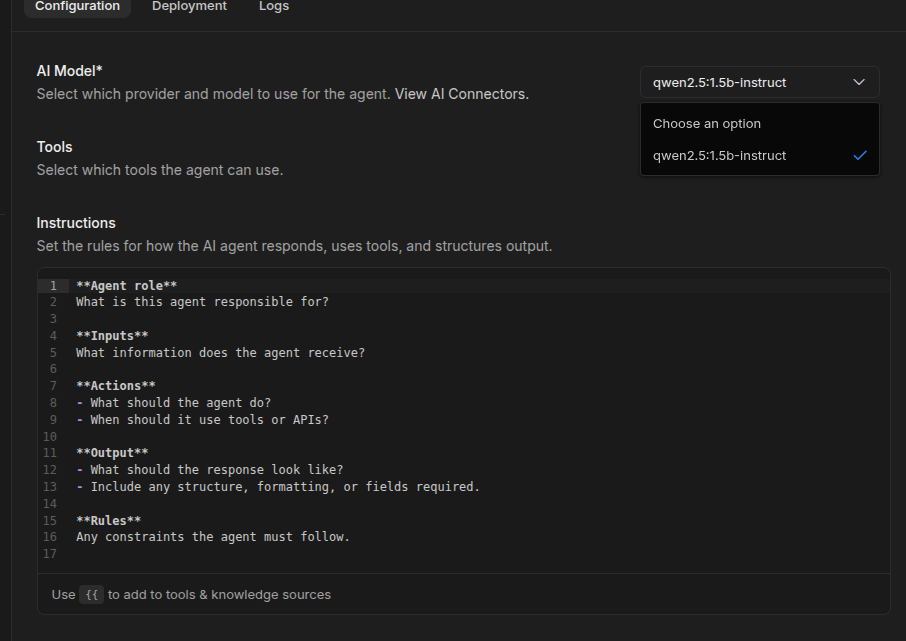

Шаг 3: Создание AI Агента

После подключения модели можно приступать к созданию агента.

- Перейдите в раздел Agents: В левом меню нажмите иконку Agents (обычно выглядит как робот или мозг).

- Создайте нового агента: Нажмите кнопку + New Agent.

- Выберите модель: В открывшемся интерфейсе нажмите Connect AI Model (или выберите из списка) и укажите только что настроенный OpenAI-коннектор с вашей

qwen2.5:1.5b-instruct.

Шаг 4: Конфигурация инструкций и инструментов (Tools)

Чтобы агент работал осмысленно, ему нужно дать инструкции и доступ к данным .

- Instructions (Инструкции):

Заполните поле «Instructions». Поскольку вы используете относительно небольшую модель (1.5b), инструкции должны быть максимально четкими и структурированными. Избегайте сложной вложенной логики.Пример инструкции:

**Agent role**

You are a helpful assistant for internal data. Respond in Russian if the user speaks Russian.

**Rules**

- Be concise.

- Use tools to fetch data if asked about specific records.

- Do not modify data unless explicitly told.

- Tools (Инструменты):

- Внизу экрана найдите раздел Tools.

- Нажмите Add Tool.

- Выберите таблицу, с которой агент должен работать (например, если у вас есть таблица «Tickets»).

- Добавьте необходимые операции: List Rows (чтение данных), Get Row (получение одной записи), Update Row (обновление). Для локальной модели лучше дать доступ к минимально необходимому набору инструментов, чтобы снизить нагрузку на контекст .

Шаг 5: Тестирование агента

В интерфейсе редактирования агента есть встроенное окно чата справа.

- Проверьте соединение: Напишите простое сообщение, не требующее обращения к базе данных, например: «Привет, кто ты?».

- Проверьте инструменты: Напишите запрос, связанный с данными: «Покажи мне последние 3 заявки».

- Если агент не отвечает или отвечает на английском, попробуйте добавить в инструкцию явное указание:

"Respond in Russian". - Модель

1.5bможет хуже следовать сложным инструкциям по форматированию JSON, чем большие модели, поэтому для критически важных задач рассмотрите использование более мощной модели или Automations вместо Agents.

- Если агент не отвечает или отвечает на английском, попробуйте добавить в инструкцию явное указание:

Тут главное чтобы Budibase видел адрес http://host.docker.internal:11434

docker exec budibase curl http://host.docker.internal:11434/api/tags